於GTC 2025大會上,NVIDIA、Alphabet與Google於代理型AI及實體AI未來展開合作,三方將共同執行多項計畫推動AI、實現AI工具普及與加速實體AI發展,希冀為醫療保健、製造、能源等產業帶來變革;其中Alphabet工程師與研究人員與NVIDIA技術團隊正利用AI與模擬技術開發具備抓取能力的機器人、藥物探索與電力網路的改善,而來自Google DeepMind、Isomorphic Labs、Intrinsic以及X的射月計畫(moonshot)Tapestry等運用NVIDIA Omniverse、NVIDIA Cosmos及NVIDIA Isaac平台的團隊,將在GTC全球AI大會上探討各自合作的里程碑。

Alphabet旗下Google Cloud將率先採用GTC 2025公布的NVIDIA GB300 NVL72機架規模解決方案與NVIDIA RTX PRO 6000 Blackwell資料中心GPU,為客戶的研究與AI生產任務大幅提升性能;同時為了確保AI生成的內容與保障智慧財產權,NVIDIA也將率先採用Google DeepMind的AI浮水印技術SynthID,使AI產生的資料如影像、聲音、文字、影片能夠追朔,並保護NVIDIA Cosmos世界基礎模型輸出的內容的完整性。

▲DeepMind將Gemma因應NVIDIA GPU進行最佳化與深度合作

同時Google DeepMind也攜手NVIDIA最佳化Google最新的Gemma輕量級開放式模型,使其在NVIDIA GPU高效的執行;同時NVIDIA也增強開發者使用Gemma的體驗,於NVIDIA AI平台,Gemma可作為高度最佳化的NVIDIA NIM微服務,並利用開源NVIDIA TensorRT-LLM函式庫展現出色的推論表現;雙方深度合作也將擴大到Google Vertex AI於NVIDIA加速運算上最佳化基於Gemma的工作負載。

Alphabet旗下專注於通用機器人智慧型自適應AI的Intrinsic也展開與NVIDIA的深度合作,提供Intrinsic Flowstate建立更深入且直覺的開發人員工作流程,並支援NVIDIA Isaac Manipulator基礎模型,作為提供通用的機器人抓取能力;借助機器人基礎模型可減少開發應用的時間並提高開發靈活性;Intrinsic將在GTC 2025期間分享Intrinsic Flowstate與NVIDIA Omniverse之間的早期OpenUSD框架串流連接,提供跨平台機器人工作的即時視覺化。

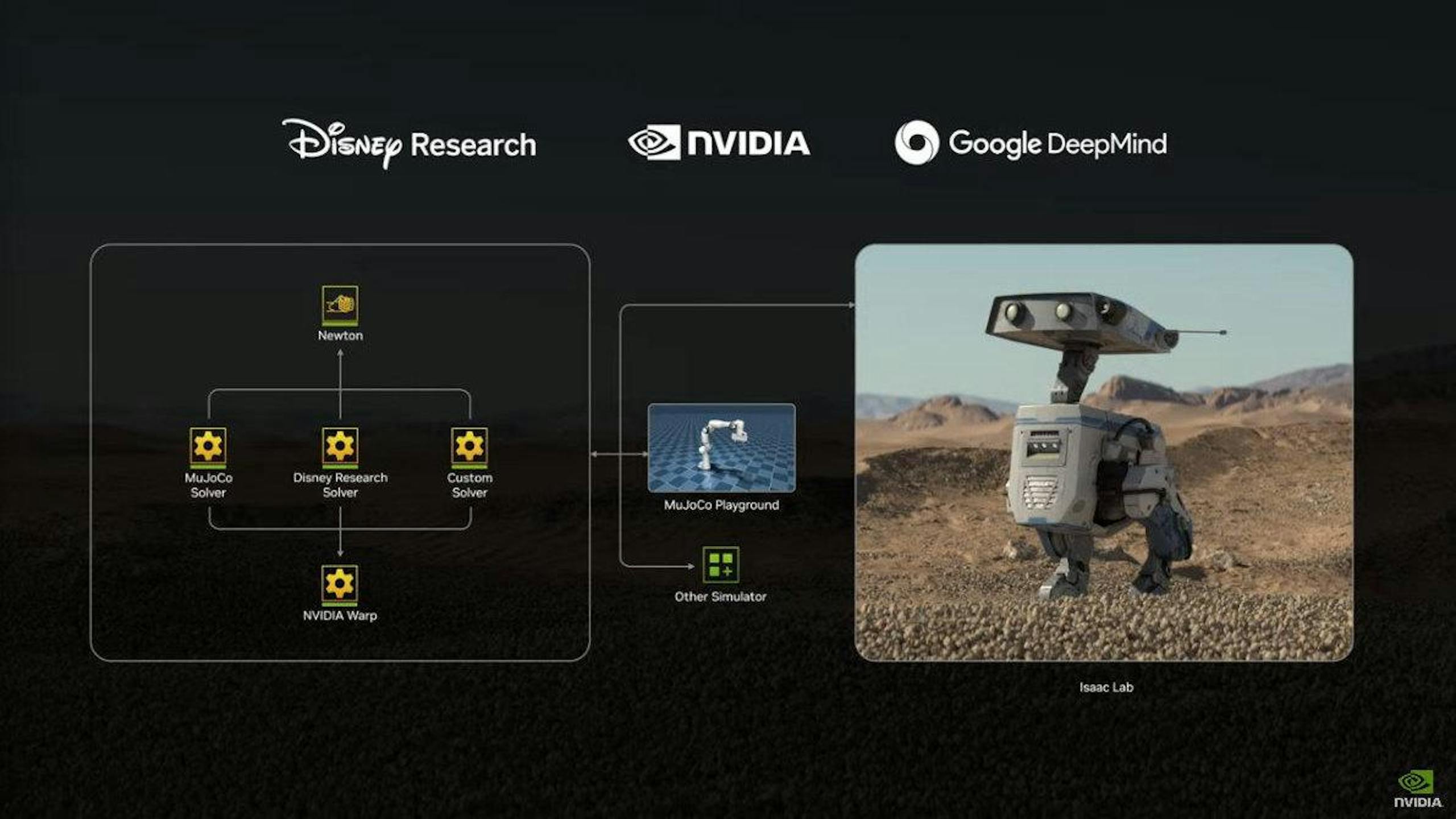

▲Google DeepMind攜手NVIDIA、Disney Research為機器人領域開發Newton物理引擎

NVIDIA亦與Google DeepMind宣布與Disney Research合作開發的Newton開源物理引擎,Newton以NVIDIA Warp框架進行加速,可相容MuJoCo通用物理引擎,借助Newton,相較MoJoCo的GPU加速模擬器MJX可提高70倍的機器人機器學習工作負載。

另外,由Google DeepMind執行長Demis Hassabis創立、以AI探索藥物開發可能性的Isomorphic Labs,也利用Google Cloud的NVIDIA GPU建立先進的藥物設計引擎,希冀利用結合AI的方式突破藥物發展。

由X在電網領域的射月計畫Tapestry旨在提供更環保、可靠的未來電網,Tapestry將攜手NVIDIA結合AI提高電網模擬速度與精確度,共同挑戰新能源與擴大電網容量,滿足資料中心與AI不斷增長的需求並確保電網的穩定性,NVIDIA與X皆將評估各種可能的解決方案,包括透過A改善互連流程,以增強能源基礎設施的規模與現代化、創造永續未來為目標。

▲Google Cloud是首波提供基於NVIDIA GB300 NVL72及NVIDIA RTX PRO 6000 Blackwell資料中心版GPU執行個體的雲端服務商之一

作為領先的雲服務商,Google Cloud也將成為首批提供基於NVIDIA GB300 NVL72及NVIDIA RTX PRO 6000 Blackwell資料中心版等Blackwell架構最新GPU執行個體的公司之一;GB300 NVL72的AI效能相較GB200 NVL72提升1.5倍,並相較機於NVIDIA Hopper的AI工廠可望創造50倍的營收機會。Google Cloud已在2025年2月提供機於NVIDIA B200與NVIDIA GB200的A4與A4X虛擬機器預覽版,後續也將陸續導入NVIDIA B300與NVIDIA GB300的虛擬機器。此外Google Cloud與NVIDIA也針對機器學習常用的Python函式庫JAX、MaxText等熱門開源框架增強於NVIDIA GPU的執行效率,其中MaxText是適用於大型GPU叢集的大型模型訓練先進框架,可在數萬個GPU高效率進行訓練。