NVIDIA 宣布 NVIDIA Reasearch 團隊將於 2023 年 8 月 6 日至 10 日之間於洛杉磯舉辦的專業電腦繪圖盛會 SIGGRAPH 公布多項與美國、歐洲以及以色列等十幾所大學共同合作的生成式 AI 與神經圖型研究論文,將包括文字轉個性化圖像、靜止圖像轉 3D 的逆向渲染、以 AI 模擬複雜 3D 元素的神經物理模型、可解所生成實時、以 AI 驅動的視覺細節的神經渲染模型等。 NVIDIA 在 SIGGRAPH 展示的研究旨在協助開發人員與企業快速產生合成資料,並能應用於機器人與自駕車的數位孿生環境,或應用在藝術、建築、平面設計、遊戲開發與電影創作作為製作分鏡、預視與高品質的影片視覺效果。

能呈現個人風格的定製文字到圖像模型

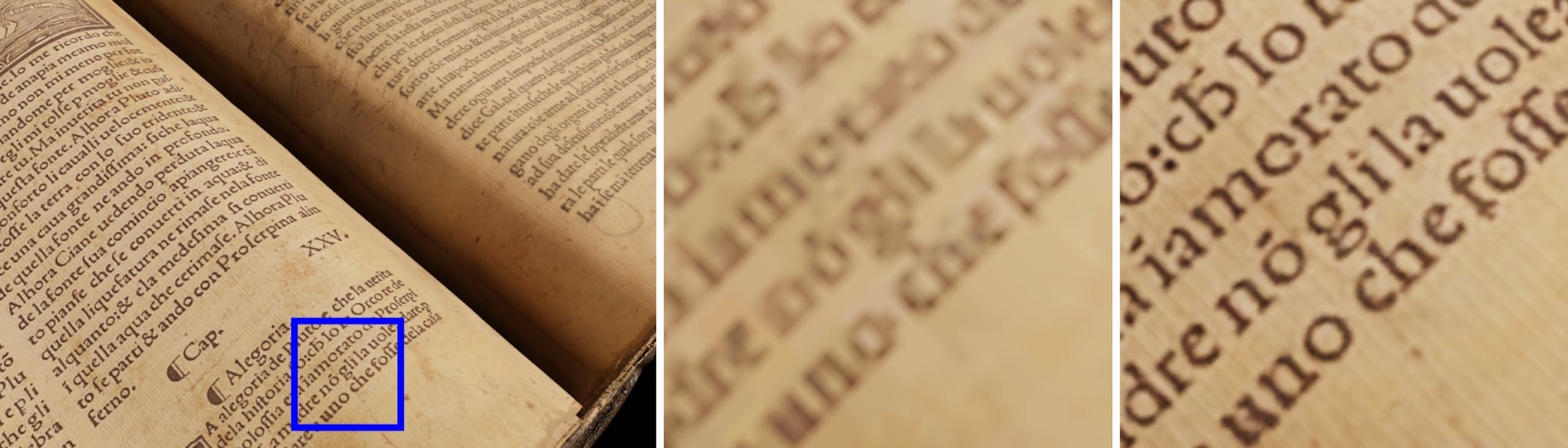

▲ NVIDIA Research 將公布兩篇與特拉維夫大學共同研究的成果論文,圍繞在如何有效率的個性化生成式 AI

透過文字轉換圖像的生成式 AI 對於創造概念藝術以及像是電影、遊戲、 3D 虛擬世界製作分鏡表是強大的工具;從文字到圖像的 AI 工具能將「兒童玩具」等關鍵提示變成幾乎無限的視覺效果,創作者可從產生的結果獲取大量的靈感。

然而當藝術家需要一個特定的主題,例如品牌創意總監希望圍以一款全新的泰迪熊商品策畫廣告活動,並在不同情況將泰迪熊形象化、例如泰迪熊茶會,就需要具備特異化的生成式 AI 模型;以色列特拉維夫大學與 NVIDIA 研究人員將在 SIGGRAPH 發表兩篇相關論文,能使使用者提供使模型可以快速學習的圖像範例。

其中一篇論文描述一種需要單一個示範圖像進行自定義輸出的技術,透過單張 NVIDIA A100 Tensor Core GPU 進行個性化的過程從以往數分鐘縮減至 11 秒,較以往個性化方式縮減 60 倍以上。

另一篇論文則介紹稱為 Perfusion 的高度緊湊模型,僅借助少量概念圖像,允許用戶將多個個性化元素(如特定的泰迪熊與茶壺)組合成一個 AI 產生的視覺效果。

從 2D 平面圖像逆向渲染 3D 物件

一旦創作者構思虛擬世界的概念藝術,下一步就是把概念藝術自 2D 的圖像轉化立體的 3D 物件; NVIDIA Research 正著手透過 AI 強化自 2D 轉 3D 的流程,使創作者能縮減原本複雜且耗時的過程,同時利於將完成的 3D 物件導入繪圖程式進行進一步編即。

NVIDIA Research 與加州大學聖地牙哥分校的研究人員的論文成果,即是探討如何透過單張 2D 肖像產生逼真的 3D 頭、肩模型;借此突破性技術, AI 能更輕易地進行 3D 頭像創作與 3D 視訊會議,且其研究成果僅需使用消費級的電腦即可即時執行,同時只需搭配傳統網路攝影機或手機的拍照功能即可完成逼真或風格化的 3D 遠端臨場。

此外, NVIDIA Research 還與史丹佛大學共同合作,為 3D 角色提供逼真的動作;雙方建立一套 AI 系統,可自真正網球 2D 影片記錄學習一系列網球技巧與動作,並將這些學習的動作套用在 3D 角色;藉 AI 學習的 3D 角色能精確地如網球選手般將球打到虛擬球場的任何目標,甚至能與其它 3D 角色進行長時間的回合比賽;同時,此篇論文還將探討如何不使用昂貴的動態捕捉設備與資料,即可創作劇多種技能與真實運動的 3D 角色的方式。

透過 AI 為 3D 角色添加逼真的毛髮細節

為 3D 角色添加逼真的細節向來對動畫師是複雜的挑戰,同時也需要耗費大量的運算資源,故以往如皮克斯等動畫電影公司經常於 SIGGRAPH 分享新作品具備多少的擬真毛髮;人類平均約有 10 萬根頭髮,同時會隨著個人動作與周遭環境呈現複雜的動態變化;在傳統的方式,動畫師與創作者需透過物理公式運算頭髮運動,並根據可用資源簡化或提供近似的頭髮運動,但畢竟需要龐大的運算量,這樣的模式多用於大製作的電影,一般即時動畫的角色較難呈現複雜的頭髮運動。

然而 NVIDIA Research 將公布的其中一篇論文結合神經物理學,能透過高解析度模擬數萬根頭髮的動作;神經物理學是一項能教導神經網路預測物體在真實世界運動的 AI 技術,在此研究當中為完整規模的頭髮準確模擬提供全新的方式,並針對現代 GPU 進行最佳化,相較使用 CPU 解算器具備更高的效能,將過往需要多天的運算縮減為僅需幾小時,同時還提升即時頭髮模擬的品質。

神經渲染對即時繪圖帶來電影品質的細節

▲神經紋理壓縮能在不占用 GPU 記憶體的前提將原本僅有中央圖片的細節提升到右邊的水準

如何建構與現實環境相同特質的數位孿生世界是現在包括各式模擬與 AAA 遊戲追求的目標, NVIDIA Research 的研究顯示,包括紋理、材料與體積的 AI 模型可在即時渲染環境提供電影級的逼真視覺效果;在這篇論文中, NVIDIA 借助神經紋理壓縮,不需佔用額外的 GPU 記憶體,即可提升 16 倍紋理細節;神經紋理壓縮能顯著提升 3D 場景的真實感,並使細節更為清晰。

此外還有一篇論文是介紹 NeuralVDB ,這是一項由 AI 驅動的資料壓縮技術,能使 3D 環境中的煙、火、雲與水等體積資料的記憶體占用減少 100 倍,意味著能以更少的 GPU 記憶體資源帶來更逼真的環境效果。

▲這套學習光線在真實多層材料反射的 AI 系統足以縮小到能夠即時執行,並呈現逼真的材質效果

先前 NVIDIA 已經在 GTC 展示更多神經材料細節的研究成果,這項研究敘述一套學習光如何從真實的多層材料反射的 AI 系統,並將這些資產的複雜性降到足以即時執行的小型神經網路,使陰影處理速度提升達 10 倍。如示範的茶壺圖像所呈現陶瓷、不完美的清釉、指紋、汙跡與灰塵。