現在不少電影、廣告甚至生活紀錄都會使用超級慢動作捕捉精彩一瞬間,現在也有不少手機標榜具備這樣的功能,不過礙於處理性能、儲存容量等種種因素,也不太可能把影片全部使用高速攝影拍攝,並僅將需要的部分使用超級慢動作播放,故多半在廣播或是運動賽事轉播的慢動作是把一般錄影機拍攝的影片放慢,但畫面就顯得不自然,有時候也不夠快。

不過現在 AI 技術也有助於使這類將低禎數影片轉化為高品質的高速慢動作影片, NVIDIA 研究人員藉由 Tesla V100 GPU 搭配基於 cuDNN 的 PyTorch 深度學習框架與捲積神經網路結構,利用高達一萬片以上的 240fps 慢動作影片做為學習藍本,做為將一般影片轉化為超級慢動作影片的深度學習模型。

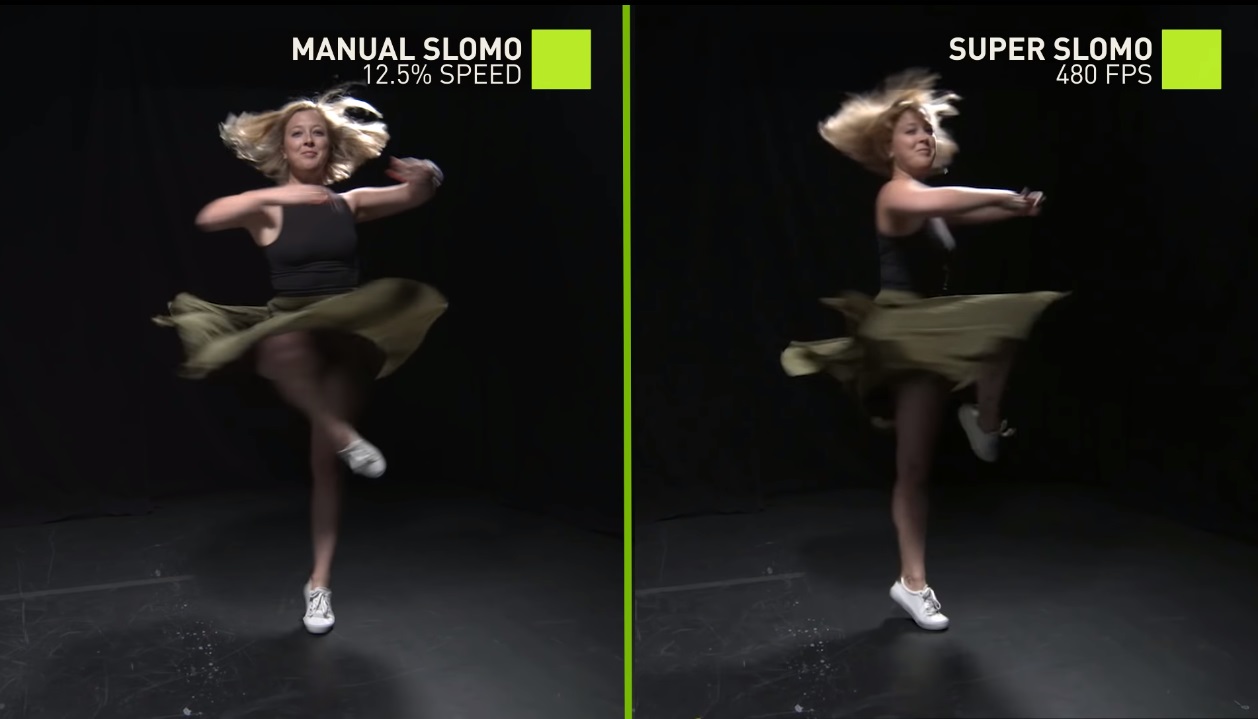

而實際的成效也相當驚人,培訓後的模型能夠自然地為每一 Frame 之間插入適宜的影像,讓一般速度的影片轉為慢動作影片也能自然不延遲。

新聞來源: NVIDIA

硬體越來越強大了